Obiettivi

SEO - Posizionarsi in alto nei motori di ricerca per keyword mirate cercate dal tuo target, generando traffico organico qualificato (vendite/lead) senza media a pagamento.

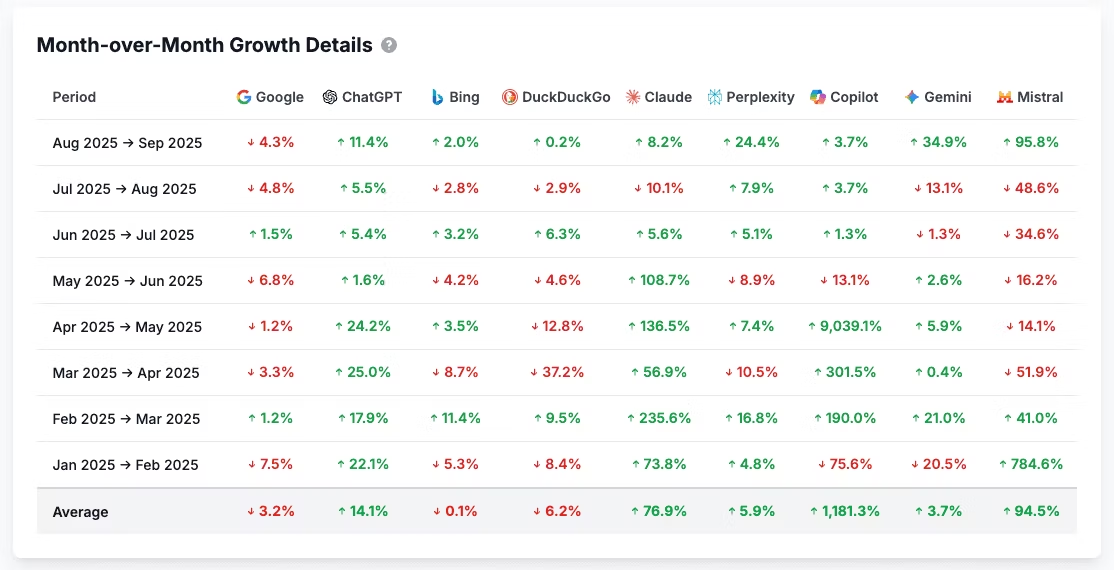

GEO - Essere citati e referenziati dentro le risposte generate da ChatGPT, Gemini, Perplexity e Google AI Overviews / AI Mode per finalità awareness e consideration. Obiettivo secondario: monitorare come vieni citato (tema / sentiment / accuratezza).

Piattaforme target (e come funzionano)

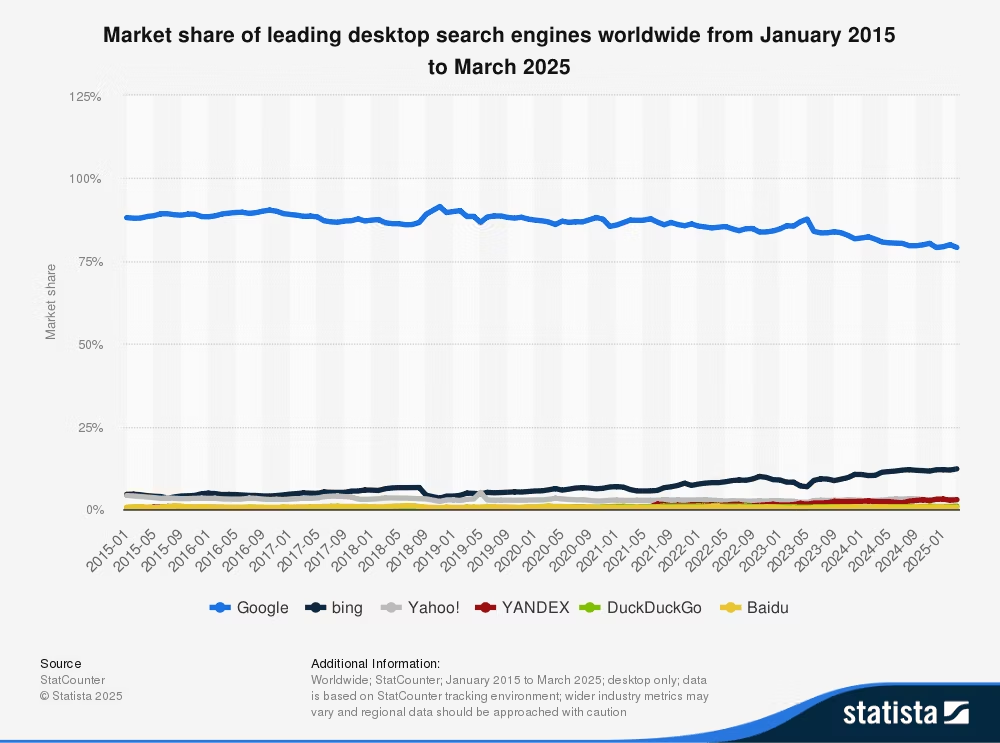

SEO - Motori di ricerca “tradizionali” (Google, Bing, Yahoo). Nota: Google oggi integra le AI Overviews in SERP, che mostrano risposte sintetiche con tanto di fonti in evidenza, sopra i risultati standard “blue links”. Oltre a queste, è stata lanciata finalmente in Italia anche la famosa AI Mode di Google che mira a fornire un’esperienza di ricerca sempre più conversazionale agli utenti. Tutto ciò per confermare che è sempre più complicato definire i soliti motori di ricerca a cui siamo tanto abituati, Google in primis, come “tradizionali”.

GEO - Focus univoco su chatbot / answer engine (ChatGPT, Gemini, Perplexity, AI Overviews). A differenza di Google che scansiona, indicizza e classifica i contenuti in una SERP ordinata, i chatbot e gli answer engine funzionano con una logica diversa:

- Ingestion e aggiornamento contenuti: l’AI “assorbe” i contenuti disponibili online, sia durante la fase di addestramento sia recuperandoli in tempo reale.

- Estrazione di conoscenza: il modello non memorizza solo testi, ma li “smonta” per ricavarne fatti, entità e relazioni (es: “Apple” → azienda, prodotti, CEO).

- Valutazione di rilevanza/affidabilità: quando arriva una query, l’AI decide quali fonti sono più attendibili e pertinenti in base al topic trattato.

- Generazione della risposta: sulla base delle fonti selezionate, produce una risposta in linguaggio naturale e può citare o attribuire direttamente i contenuti da cui ha preso le informazioni per finalità di trasparenza.

Processi di retrieval

SEO - Crawling, indexing e ranking basato su fattori come: pertinenza semantica rispetto alla keyword target, domain authority, segnali di user-experience, qualità del contenuto, fattori tecnici (velocità, mobile, sicurezza). L’esito è una posizione in SERP in confronto ai competitor.

GEO - Il funzionamento della GEO si basa su una branca avanzata dell’AI chiamata Natural Language Processing (NLP), e in particolare su un’architettura di rete neurale detta Transformer. Questo approccio consente di comprendere, contestualizzare e generare testo in modo coerente e pertinente.

1. Addestramento su vasta scala

L’AI è stata addestrata su un’enorme quantità di testi e codice provenienti anche dal web (ma non solo). Questo processo ha permesso al modello di apprendere grammatica, sintassi, semantica e una vasta gamma di conoscenze. L’ampiezza e la diversità dei dati di training costituiscono la base della sua capacità di generare risposte precise e naturali.

2. Codifica dell’input e ricerca semantica

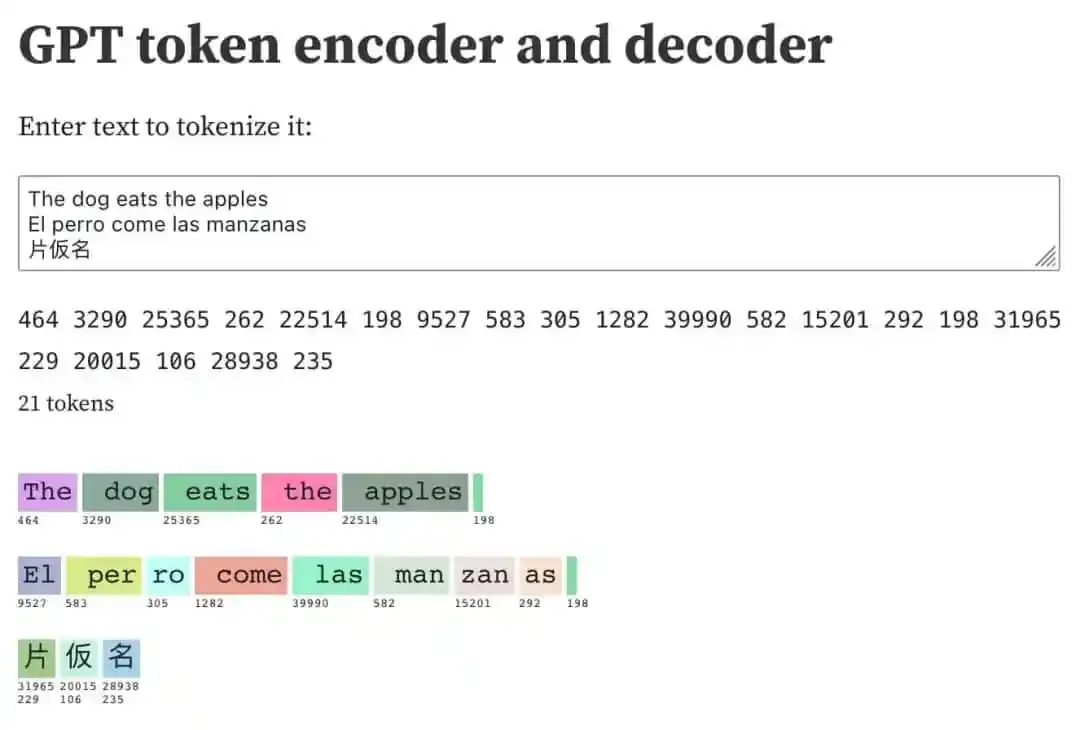

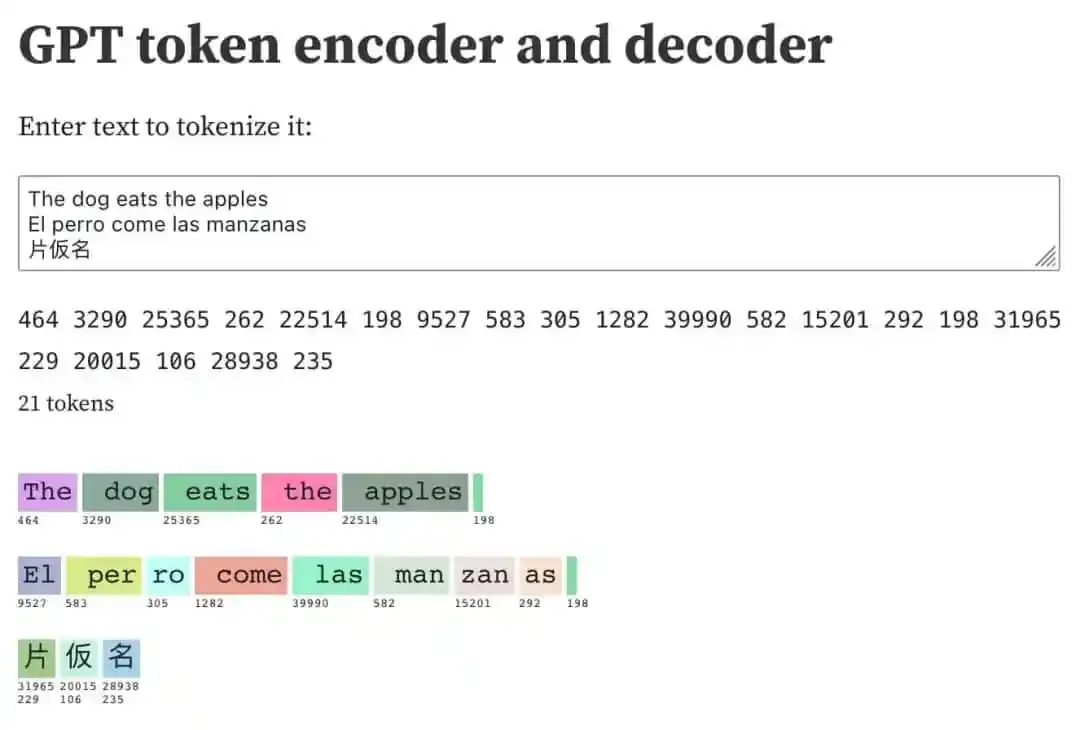

Quando viene ricevuta una domanda, il testo viene suddiviso in token, cioè unità linguistiche minime (parole, parti di parole o segni di punteggiatura). Questi token vengono trasformati in vettori numerici che la rete neurale può elaborare. In questa rappresentazione vettoriale (vector embedding), parole o frasi con significato simile si trovano vicine tra loro nello spazio semantico (ad esempio “cane” e “cucciolo”). Quando viene effettuata una ricerca o una richiesta, il sistema traduce la query in un vettore e individua i contenuti più affini tramite ricerca per similarità (tipicamente tramite un sistema di confronto basato su “cosine similarity” o “similarità del coseno”). Questo consente di comprendere chiaramente l’intento dell’utente e il contesto esatto della sua richiesta, per poter fornire una risposta pertinente.

3. Elaborazione del contesto: il meccanismo di attenzione

Il cuore della tecnologia Transformer è il meccanismo di attenzione, che consente al modello di analizzare l’intero contesto di una frase o conversazione. Ogni parola riceve un “peso” differente in base alla sua importanza semantica, permettendo di cogliere sfumature, relazioni e ambiguità che caratterizzano il linguaggio naturale.

4. Generazione e decodifica della risposta

La generazione della risposta avviene attraverso un processo di predizione iterativa: il modello calcola quale parola (token) ha la probabilità più alta di seguire logicamente e grammaticalmente le precedenti. Ogni parola scelta viene aggiunta alla sequenza e il processo si ripete finché non si raggiunge un punto di chiusura, producendo frasi e paragrafi coerenti e informativi. In sintesi, l’AI non “comprende” il mondo come un essere umano, ma è in grado di riconoscere e riprodurre pattern linguistici complessi, generando contenuti che suonano naturali, coerenti e rilevanti.

5. Citazione delle fonti più autorevoli

Quando si parla di sistemi ibridi AI (es. Google AI Mode, AI Overviews, Gemini o ChatGPT Plus) la generazione della risposta e la citazione delle fonti seguono un processo in due fasi (spesso definito RAG, Retrieval-Augmented Generation). Questi sistemi decidono l'inclusione e l'ordine delle fonti web più autorevoli sulla base di due pilastri: i modelli di confronto degli embeddings e il sistema di reranking.

- Confronto (retrieval): l'AI trasforma la query dell'utente e i potenziali documenti web in vettori numerici (embeddings). Per misurare la vicinanza semantica tra la domanda e i contenuti disponibili, un metodo largamente impiegato è la similarità del coseno, anche se esistono algoritmi alternativi per identificare il set iniziale di fonti pertinenti. Se nel processo di retrieval viene impiegata una metrica di similarità diversa dalla similarità del coseno (ad esempio, la distanza euclidea), l'identificazione iniziale delle fonti pertinenti può cambiare notevolmente, influenzando di conseguenza il set finale di riferimenti citati.

- Reranking (generation): una volta identificato questo set di fonti, entra in gioco un complesso modello di reranking. Questa fase è cruciale e distingue le piattaforme tra loro. Le AI sfruttano diversi fattori per stabilire l'ordine finale. Google, ad esempio, può integrare i suoi fattori di classifica tradizionali, come un Authority Score legato al brand e alla sua pertinenza semantica, o fattori che valutano la veridicità e l'affidabilità oggettiva delle informazioni fornite dalla fonte (insieme a svariati altri fattori non noti ma che i SEO hanno imparato a decodificare con la loro expertise nel corso del tempo). Piattaforme come ChatGPT potrebbero utilizzare, invece, altri meccanismi di ranking proprietari, che, pur perseguendo l'obiettivo di pertinenza e qualità, possono basarsi su calcoli e priorità interne differenti. Questa divergenza nel reranking spiega perché, a parità di prompt, l'elenco delle fonti citate e il loro ordine possono differire tra i risultati forniti da Gemini e quelli offerti da ChatGPT.

Query target

SEO - Keyword categorizzate in base alle diverse fasi del funnel di conversione (TOFU / MOFU / BOFU), distinzione tra keywords short tail e long tail.

GEO - Domande conversazionali ad alta specificità, spesso molto più lunghe e articolate di una keyword long-tail classica (es: “Qual è la differenza pratica tra GEO e SEO per un eCommerce fashion in Europa e come misurarla nei prossimi 90 giorni?”).

Esempio

SEO: “scarpe running donna ammortizzate” (long tail)

GEO: “Devo correre su asfalto 3 volte a settimana: quali scarpe da running donna minimizzano l’impatto su ginocchia e come scegliere il drop giusto?”

Focus sulle attività

SEO - Tecnica (es. gestione crawling / indexing o dati strutturati), contenutistica / semantica (focus su parametri E-E-A-T), link building e Digital PR, attività geolocalizzate.

GEO - Focus su attività ad impatto diretto a livello di training dei modelli LLM:

- Gestione crawlability: ridurre dipendenza da JavaScript, privilegiare rendering SSR piuttosto che CSR, gestione file robots.txt, tag meta robots, attributi canonical. Obiettivo: rendere recuperabili i contenuti dai crawler AI.

- Ottimizzazione semantica: scrivere sulla base di user intent e passage-level, coprendo gli aspetti semantici di rilievo (attraverso la simulazione di tecniche di fan-out) che un LLM potrebbe estrarre in base al contesto del prompt.

- Schematizzazione: frasi brevi e concise, concetti semantici chiari e ben distinti, schemi FAQ e Q&A, elenchi numerati o puntati, tabelle e heading tags.

- Schema markup: implementazione dei dati strutturati per facilitare il processo di tokenizzazione da parte dei chatbot / answer engines.

- Brand reputation: massimizzazione della quantità di fonti autorevoli che parlano di te (media, forum generalisti o di settore, siti di review, social media).

- Ottimizzazione delle performance tecniche: lavorare su velocità e stabilità dei tempi di caricamento per evitare time-out dei crawler e migliorare la UX.

- Conversion rate optimization: sfruttare ogni singola sessione generata da citazioni attraverso answer engines per massimizzare il numero di lead / transazioni.

Queste attività esistono anche in SEO, ma in GEO sono essenziali perché impattano direttamente sui processi di inclusione / citazione all’interno delle risposte AI.

Comportamento utente

SEO - L’utente scorre la SERP e se non vi sono snippet o AI Overviews che forniscono già risposte dirette alla sua ricerca, clicca il risultato più rilevante (tipicamente all’inizio della SERP stessa) e approfondisce la navigazione sul sito (sessione web).

GEO - L’utente riceve risposte immediate e può non cliccare nulla. Serve quindi influenzare la risposta e misurare citazioni e traffico indotto.

Aggiornamento piattaforme

SEO - Continui “micro-update” (anche giornalieri) e Core Updates generali periodici (tipicamente trimestrali/quadrimestrali, ma a volte anche mensili).

GEO - Retraining/finetuning continui e major release dei modelli (spesso con cadenza annuale e con espansione del quantitativo di fonti a disposizione).

Metriche & KPI

SEO - Impressioni e clic organici, Click-Through-Rate, tasso di engagement, Domain Authority (o metriche simili), conversioni generate (vendite/lead).

GEO - Tasso di visibilità nelle piattaforme AI, tasso di citazione (share of voice AI), sentiment delle menzioni, impatto su sessioni e vendite attribuibili alle risposte AI. Strumenti dedicati aiutano a vedere dove e come appari (ma solo per prompt ipotetici e non realistici).

Tool utilizzati

SEO - Google Analytics 4 e Google BigQuery (o altri strumenti di Data Analytics), suite SEO (es. Semrush o Ahrefs), Google Search Console, Bing Webmaster Tools e simili.

GEO - Google Analytics 4 e Google BigQuery per sessioni da Answer Engine e nuovi strumenti di AI Visibility, come: Semrush AI SEO Toolkit, Profound, Peec AI. Utili per avere una panoramica della propria visibilità AI (ma attraverso prompt ipotizzati e non realistici).